En lille, ny robot er kommet til verden i laboratorierne på Ingeniørhøjskolen Aarhus Universitet. Den har mekaniske øjne og ører og giver operatøren helt nye muligheder for intuitiv styring.

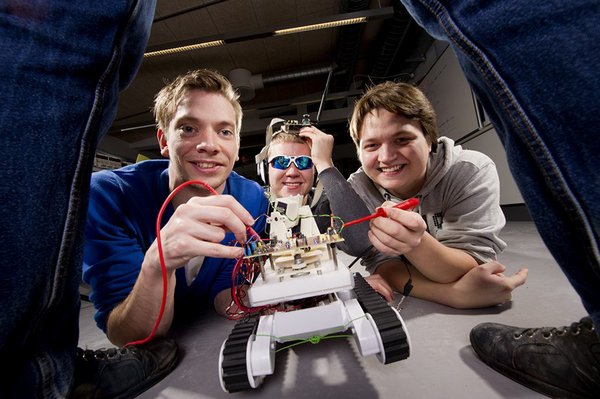

En gruppe ingeniørstuderende har skabt en lille ny robot med indbygget elektronisk isenkram, der gør det muligt for den både at ”se”, ”høre” og bevæge sig i samme takt som dens operatør. På billedet ses fra højre: Mikkel Stampe Pedersen, Jakob Flarup Øllgaard og Allan Hansen. (Foto: Henrik Olsen)

Det ligner en krydsning imellem en hund og et elektronikskab. Et lille væsen fyldt med dioder, kabler, antenner og sensorer. Og så kan den noget helt særligt. Den både ser og hører og sender fuldstændig autentisk sansefeedback tilbage til dens operatør.

”De fleste robotter er programmeret til at udføre blot en enkelt, bestemt opgave. Vi har taget vores robot skridtet videre og givet den sanser. Det, den ser og hører, kan den sende videre i realtid til det menneske, som styrer den,” siger Jakob Flarup Øllgaard, ingeniørstuderende ved Aarhus Universitet.

I sig selv er det ikke nyt, at en robot har elektroniske sanser. Det er heller ikke nyt, at den kan sende informationer til dens operatør. Det er selve måden hvorpå, det sanselige feedback registreres, som er interessant, forklarer Jakob Flarup Øllgaard:

”Som operatør får man oplevelsen af at smelte sammen med robotten og at være hundrede procent tilstede i de omgivelser, den befinder sig i. Det giver en helt anden operatøroplevelse og en langt mere intuitiv form for styring.”

Hovedbevægelser styrer robottens øjne

Robotten er foreløbig udstyret med et bevægeligt modul, som indeholder et lille kamera og to mikrofoner. Man styrer den ved hjælp af en hjelm og sine egne hovedbevægelser. Med et par hørebøffer og briller med indbygget skærm, modtager man video- og lydoptagelser fra det sted, hvor robotten befinder sig. I hjelmen er der indbygget kompas, gyroskop og accelerometer, der via en lille computer kan beregne operatørens nøjagtige position og synsretning og sende disse informationer trådløst til robotten, som indstiller sig efter dem uden forsinkelse i tid.

”Det giver en meget autentisk fornemmelse af tilstedeværelse. Man får slet ikke fornemmelsen af, at man ser videooptagelser og hører lydoptagelser, men at det er ens egne øjne og ører, der registrerer omgivelserne et helt andet sted,” siger Martin Boye Petersen, ingeniørstuderende Aarhus Universitet

Robottens øjne følger operatørens synsretning, og han kan på den måde orientere sig i ethvert givent område uden blinde vinkler. De mekaniske køreegenskaber frem, tilbage og til siden styres trådløst med et joystick, og lyden gengives via mikrofonerne i et tredimensionelt lydbillede med en fuldstændig realistisk bredde, dybde og højde.

Kan give bedre overvågning

Robottens største fordel er, at den gør styringen mere intuitiv og derfor langt nemmere. Det er et koncept, som kan tilpasses robotter i alle industrier og gøre operatører i stand til at udføre deres opgaver nemmere og med højere grad af præcision.

De studerende har i første omgang udviklet robotten med sigte på, at den kan anvendes i vagt- og overvågningsbranchen.

”I stedet for at sætte videokameraer op overalt i bygninger, kan man nøjes med en robot. Det er mere effektivt, fordi den kan kigge overalt og nemt forfølge et objekt,” siger Martin Boye Petersen.

Robotkonceptet kan også komme til gavn i for eksempel militær- og katastrofeområder, hvor det er risikabelt for mennesker at færdes.